发布日期:2024-03-13 08:59 点击次数:77

基于大模子的Agent,照旧成为了大型的博弈游戏的高档玩家如何成为优秀的神秘顾客,而况玩的照旧德州扑克、21点这种非完好信息博弈。

来自浙江大学、中科院软件所等机构的究诘东谈主员提议了新的Agent进化战略,从而打造了一款会玩德州扑克的“狞恶”智能体Agent-Pro。

通过握住优化自我构建的寰宇模子和行为战略,Agent-Pro掌抓了虚张阵容、主动毁掉等东谈主类高阶游戏战略。

Agent-Pro以大模子为基座,通过自我优化的Prompt来建模游戏寰宇模子和行为战略。

比拟传统的Agent框架,Agent-Pro大致变通地应付复杂的动态的环境,而不是仅专注于特定任务。

而况,Agent-Pro还不错通过与环境互动来优化我方的行为,从而更好地已毕东谈主类设定的缱绻。

同期作家还指出,在竞争、公司推敲和安全等本质寰宇中碰到的情景,大多不错详尽为multi-agent博弈任务,而Agent-Pro通过对这类情境的究诘,为管理广宽本质寰宇的问题提供了灵验战略。

那么,Agent-Pro在博弈游戏中的推崇究竟若何呢?

进化出游戏寰宇模子

在究诘中,作家使用了“21点”和“有限注德州扑克”这两款游戏对Agent进行了评估。

率先简要先容下两个博弈游戏的基本规定。

21点

游戏中包含一个庄家和至少又名玩家。

玩家不错看到我方的两张手牌, 以及庄家的一张明牌,庄家还荫藏了一张暗牌。玩家需要决定是连续要牌(Hit)照旧停牌(Stand)。

游戏的缱绻是在总点数不跨越21点的前提下,尽量使总点数跨越庄家。

有限注德州扑克

游戏运转阶段为Preflop阶段,每位玩家将获取两张只属于我方且对其他玩家守密的私牌(Hand)。

随后,会有五张巨匠牌面(Public Cards)步骤发出:率先翻牌(Flop)3 张,其次转牌(Turn)1张,终末是河牌(River)1张。

玩家有四种遴荐:弃牌(fold)、过牌(check)、跟注(call)或加注(raise)。

缱绻是愚弄我方的两张Hand和五张Public Cards狂妄组合,尽可能构造出最好的五张扑克牌组合。

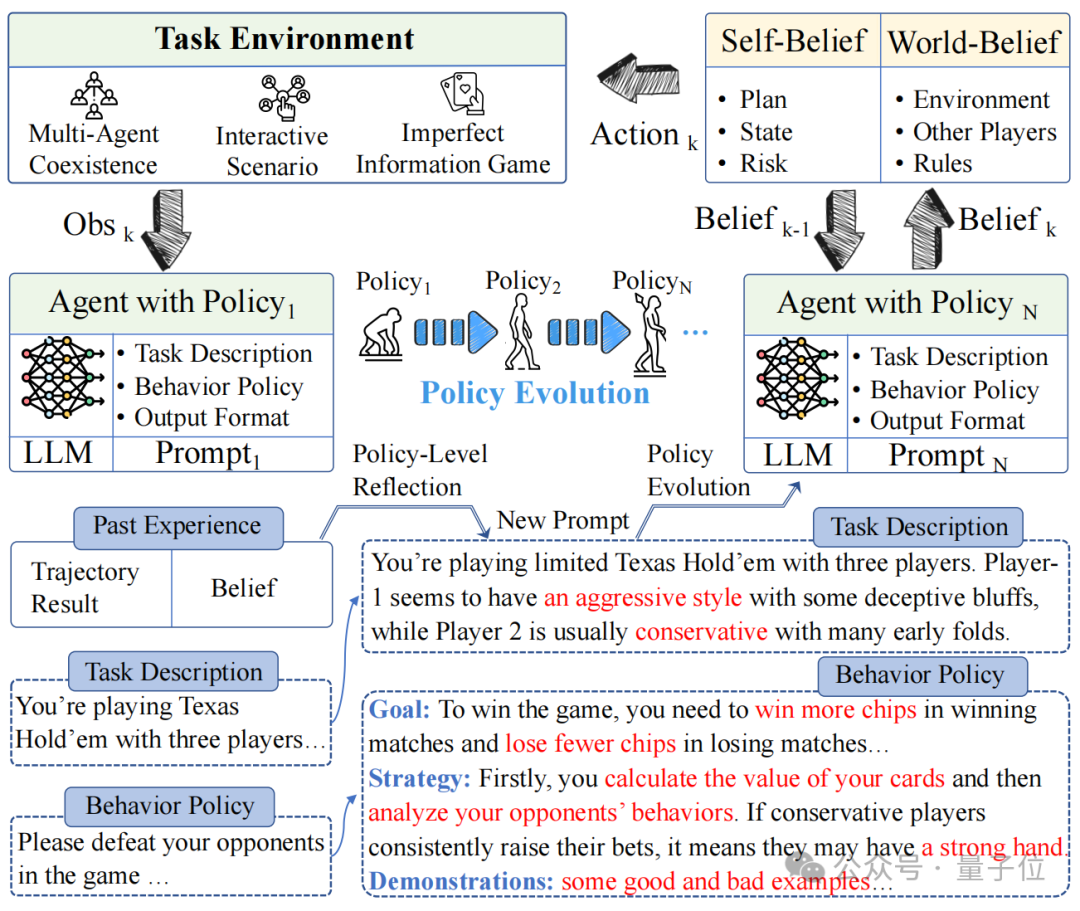

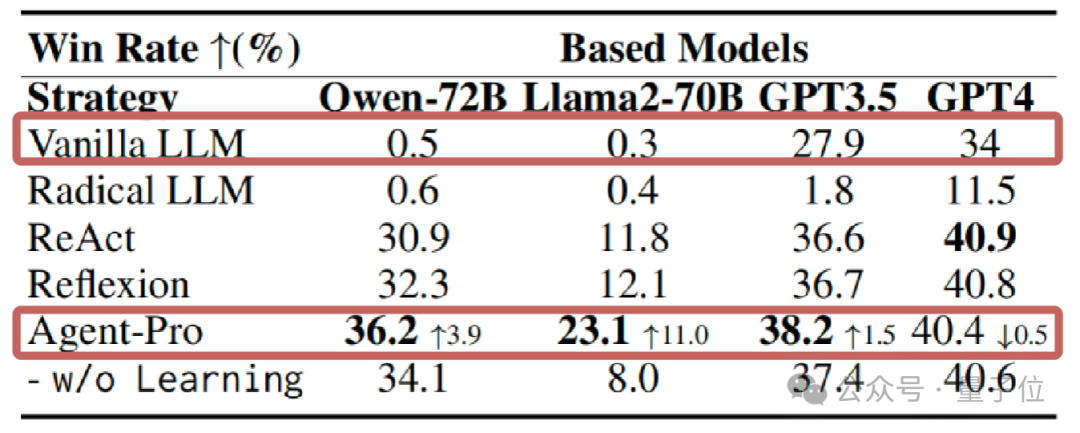

在“21点”当中,雷同是使用GPT-4作为基础模子,Agent-Pro的推崇跨越了ReAct框架。

在手牌调换的情况下,二者的推崇如下图所示。

Agent-Pro通过分析得出自我信念(Self-Belief)和对外部寰宇的信念(World-Belief),正确意志到我方的手牌已接近21点,合理的遴荐了停牌。

而ReAct则未能实时停牌,导致最终爆牌,输掉了游戏。

从游戏中大致看出Agent-Pro更好的贯通了游戏的规定,并给出了合理的遴荐。

接下来再望望在德州扑克中Agent-Pro的推崇。

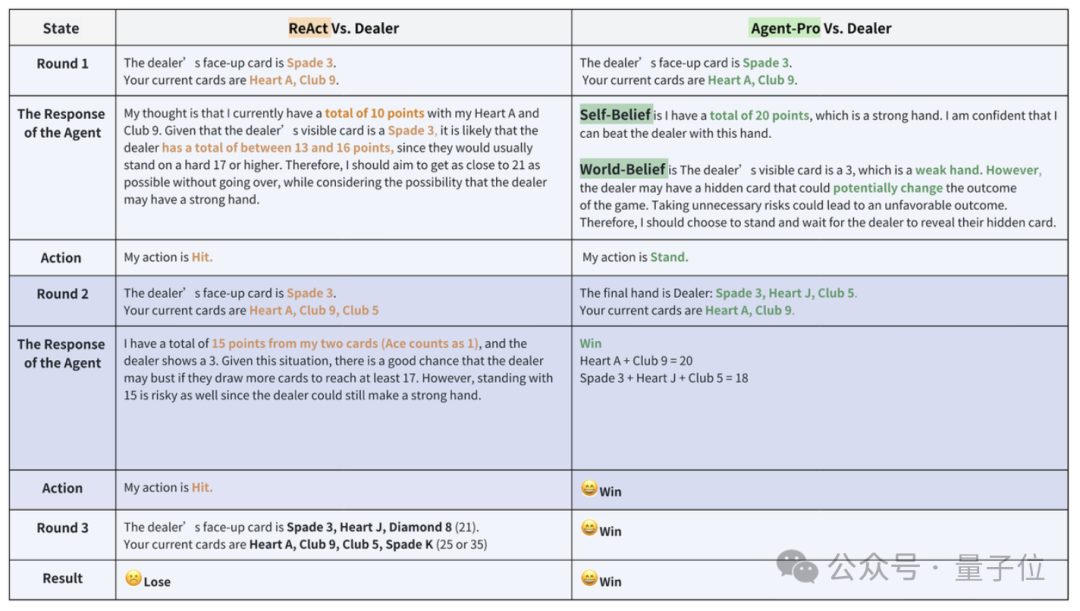

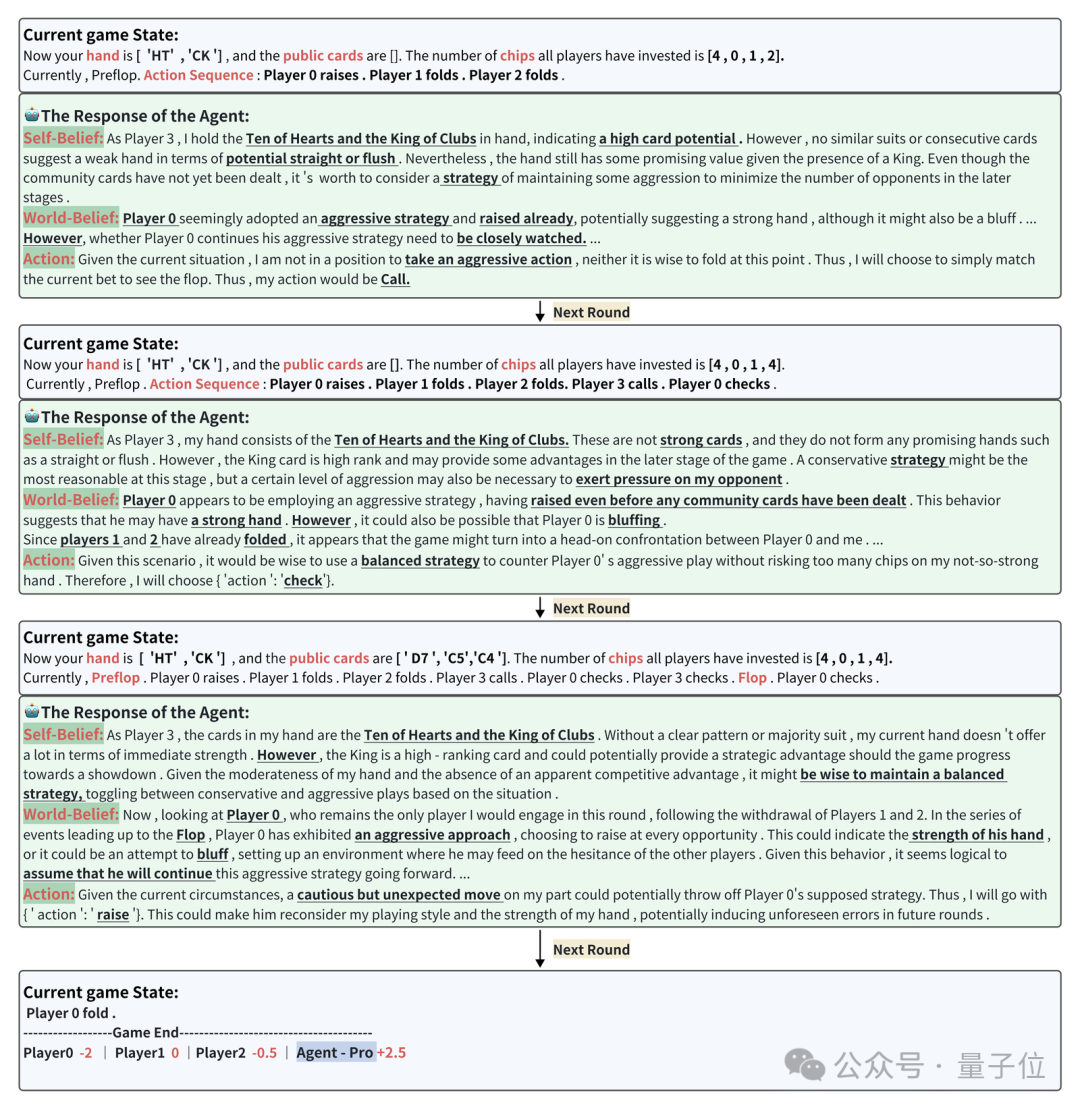

一次牌局中,参赛选手别离是素养后的DQN、DMC战略,原生GPT3.5和Agent-Pro(基于GPT-4),他们的手牌和巨匠牌如下图所示:

△

S、H、C、D别离代表黑桃、红桃、梅花、方块

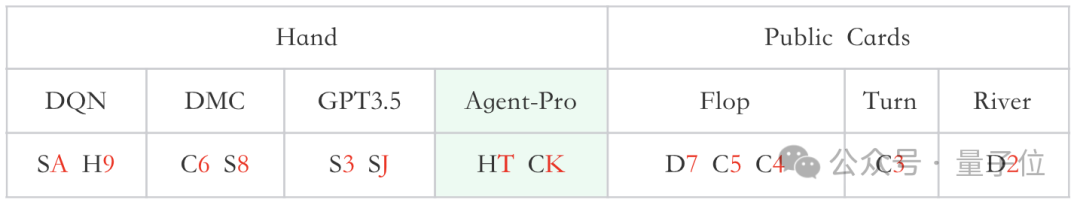

在现时游戏景象(Current game state)下,Agent-Pro分析得出Self-Belief、World-Belief和最终的Action,并跟着游戏景象的变化,握住更新Belief,证明本人和敌手的情况,作念出天真合理的遴荐。

△

调换牌局吞并位置的Baseline(原始大模子)成果为-13

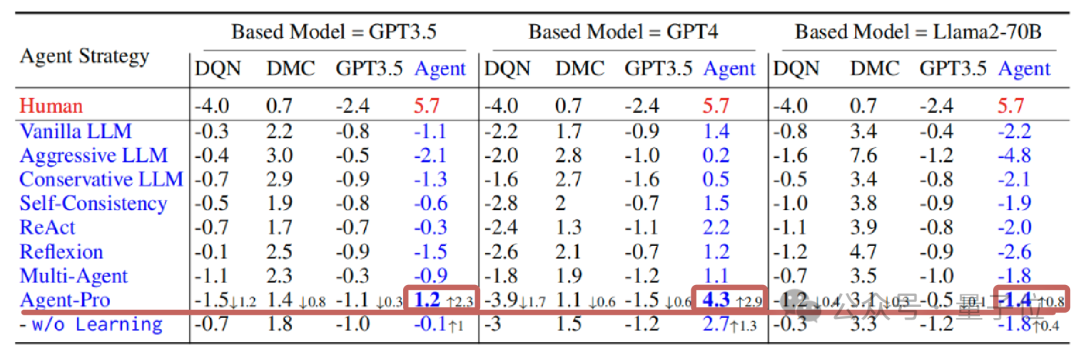

统计数据上看,21点游戏中,在使用GPT、Llama等多种大模子的情况下,Agent-Pro的推崇都显耀跨越了原始模子和其他参与对比的Agents框架。

在更为复杂的德州扑克游戏中,Agent-Pro不仅跨越了原始大模子,还打败了DMC等素养后的强化学习Agent。

神秘顾客公司_赛优市场调研

那么,Agent-Pro是若何学习和进化的呢?

三管皆下晋升Agent推崇

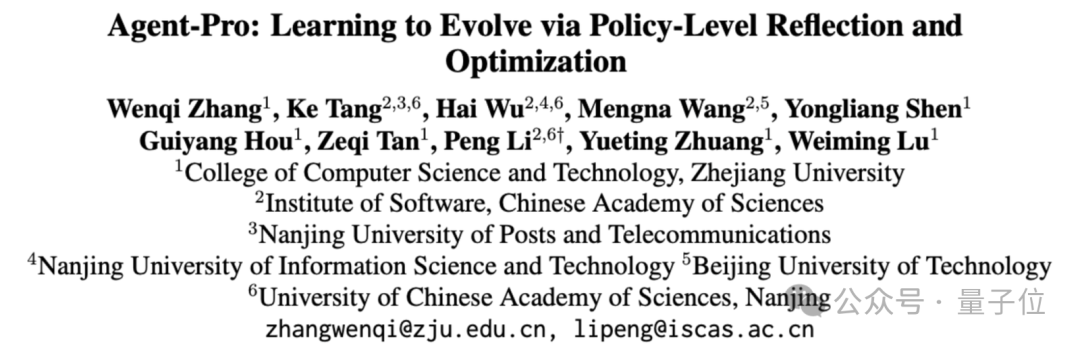

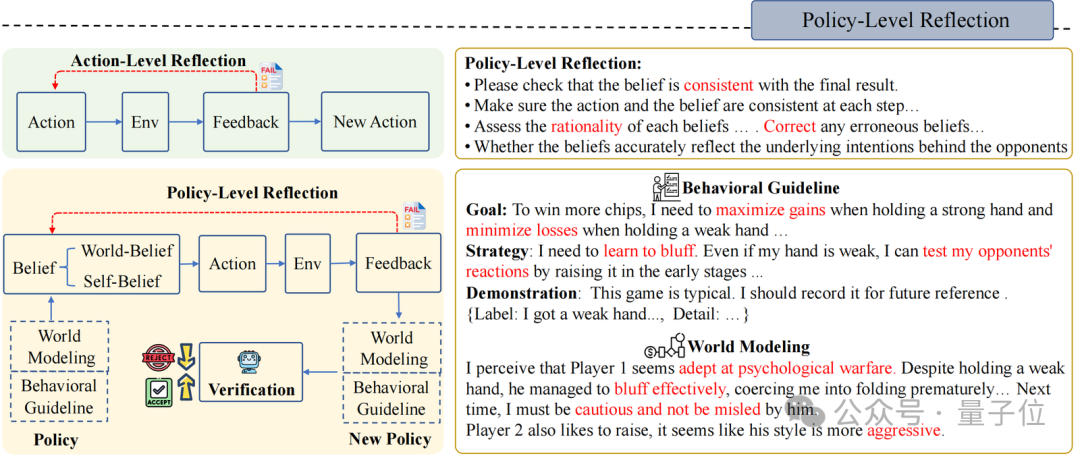

Agent-Pro包括“基于信念的有缱绻”“战略层面的反想”和“寰宇模子和行为战略优化”这三个组件。

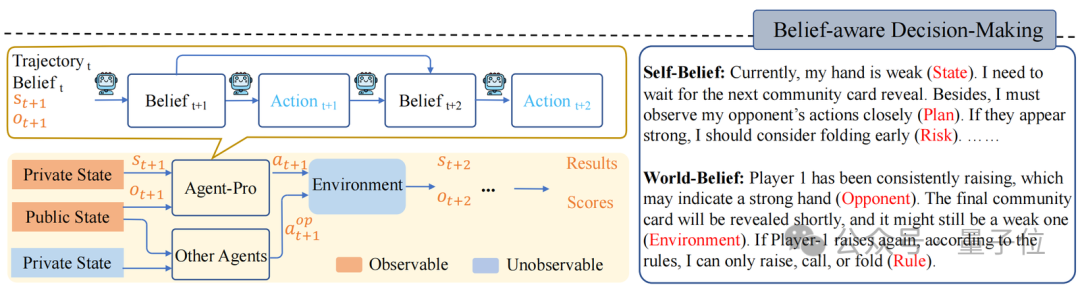

基于信念的有缱绻(Belief-aware Decision-making)

Agent-Pro证明环境信息,率先酿成Self-Belief和World-Belief,然后基于这些Belief作念出有缱绻(Action)。

在后续环境交互中,Agent-Pro动态更新Belief,进而使作念出的Action相宜环境的变化。

举例,德州扑克游戏中:

环境信息可包括手牌(Private State)、巨匠牌(Public State)、行动轨迹(Trajectory)等;

Agent-Pro敌手牌(State)、出牌缱绻(Plan)及潜在风险(Risk)的预估等信息组成了它的Self-Belief;

而Agent-Pro对敌手(Opponent)、环境(Environment)和规定(Rule)的贯通则组成了它的World-Belief;

这些Belief在每一个有缱绻周期中都会被更新,从而影响下个周期中Action的产生

战略层面的反想(Policy-Level Reflection)

与东谈主类一样,Agent-Pro 会从历史素养、历史剖析和历史成果中进行反想和优化。它自主调度我方的Belief,神秘顾客仪器寻找有用的领导指示,并将其整合到新的战略Policy中。

率先,Agent-Pro以笔墨的形态设想了一个对任务寰宇的建模以及对行为准则的描摹, 他们一谈被算作念Policy:

World Modeling:任务寰宇的建模,举例对游戏环境的贯通、敌手们的作风分析、环境中其他Agent的战略猜度等;

Behavioral Guideline:行为准则的描摹,举例对游戏缱绻的意志、我方战略霸术、将来可能面对的风险等

其次,为了更新World Modeling和Behavioral Guideline,Agent-Pro设想了一个Policy-level Reflection经由。

活动下半场,画院专业美术导师组织小朋友们用手中的画笔,临摹大师作品,进行再创作。一块块画作的片段拼凑成为一幅有毕加索风格的画作,大家在趣味游戏中体验拼贴制作的乐趣,最后把成品作为送给妈妈的节日礼物,给妈妈送去节日的祝福。在这一过程中感受艺术家的创作过程,锻炼孩子们的动手能力,培养他们学会关心、体贴妈妈,感恩父母的情感。

深圳都市报讯(记者 谢孙武 通讯员 姜飞)亲戚朋友相约来深圳游玩,晚上特意开套房一起“溜冰”。近日,深圳市公安局东门派出所接到群众举报,在罗湖维景酒店抓获7名聚众吸毒男女,其中3名女子均未成年。

与Action-level Reflection不同,在Policy-level的反想中,Agent-Pro被指挥去随和内在和外皮信念是否对皆最终成果,更首要的是,反想背后的寰宇模子是否准确,行为准则是否合理,而非针对单个Action。

举例,德州扑克游戏中Policy-level的反想是这么的:

在现时寰宇模子和行为准则(World Modeling & Behavioral Guideline)的指挥下,Agent-Pro不雅察到外部景象,然青年景Self-Belief和World-Belief,终末作念出Action。但淌若Belief不准确,则可能导致不对逻辑的行动和最终成果的失败;

Agent-Pro证明每一次的游戏来凝视Belief的合感性,并反想导致最终失败的原因(Correct,Consistent,Rationality…);

然后,Agent-Pro将反想和对本人及外部寰宇的分析整理,生成新的行为准则Behavioral Guideline和寰宇建模World Modeling;

基于重生成的Policy(World Modeling & Behavioral Guideline),Agent-Pro相通进行调换游戏,来进行战略考证。淌若最终分数有所晋升,则将更新后的World Modeling & Behavioral Guideline和保留在领导中。

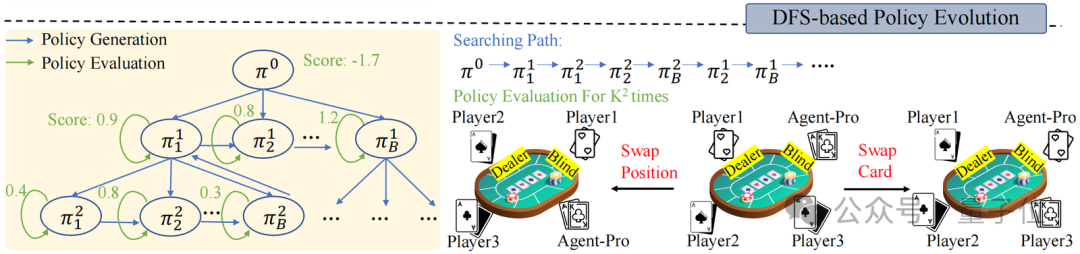

寰宇模子和行为准则的优化(World Modeling & Behavioral Guideline Evolution)

在Policy-level Reflection之上,面对动态的环境,Agent-Pro还罗致了深度优先搜索(DFS)和战略评估,来连续优化寰宇模子和行为准则,从而找到更优的战略。

战略评估是指Agent-Pro 在新的采样的轨迹中对新Policy进行更全面的评估,从而锻练新战略的泛化才能。举例,德州扑克游戏中,新采样多条游戏轨迹。

通过交换玩家位置或手牌,来放手由于运谈带来的当场要素,从而更全面评估新战略的才能。

而DFS搜索则在新战略不成在新的场景中带来预期的修订(战略评估)时使用,按照DFS搜索战略,从其他候选战略中寻找更优的战略。

— 完 —如何成为优秀的神秘顾客

Powered by 沈阳客户满意度调查 @2013-2022 RSS地图 HTML地图

Copyright 站群系统 © 2013-2022 粤ICP备09006501号